URL

TL;DR

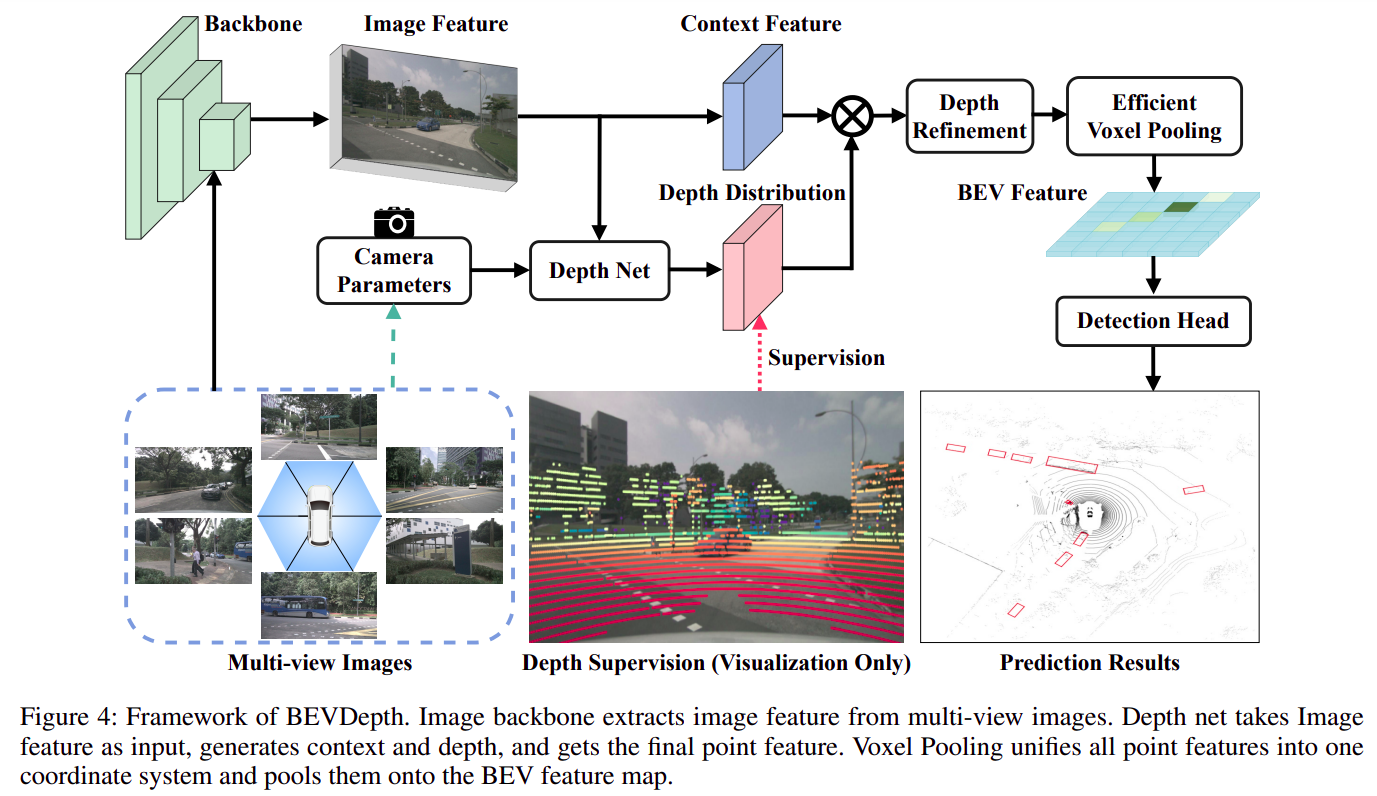

- 本文提出一种

BEV视角下的的3D目标检测算法,作者认为尽管深度对相机3D检测至关重要,但最近的方法中的深度估计却出奇地不足。 BEVDepth通过利用显式深度监督(来自lidar点云)来解决这个问题。- 同时使用关键帧和过渡帧在

bev feature维度进行特征融合,引入时序信息,提高模型效果。

Algorithm

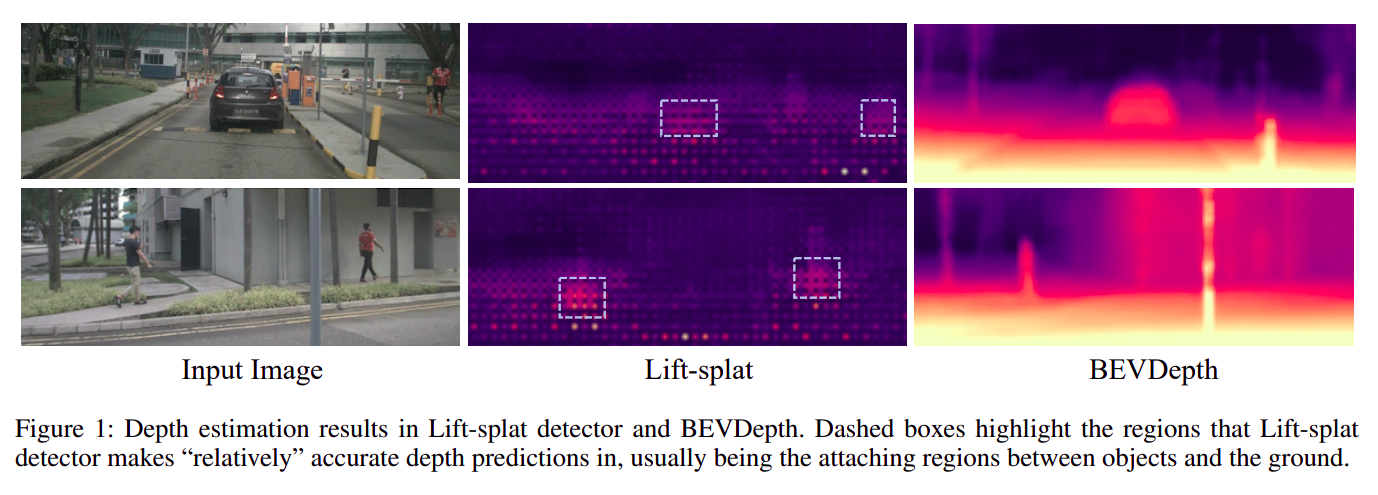

- 与

BEVDet4D的pipeline很相似,区别是BEVDepth使用了DepthNet用激光雷达点云数据做了深度监督。 DepthNet深度监督的输入是6v图像特征和每个相机的内外参,输出为 相机相关深度估计(camera_awareness_depth_estimation)

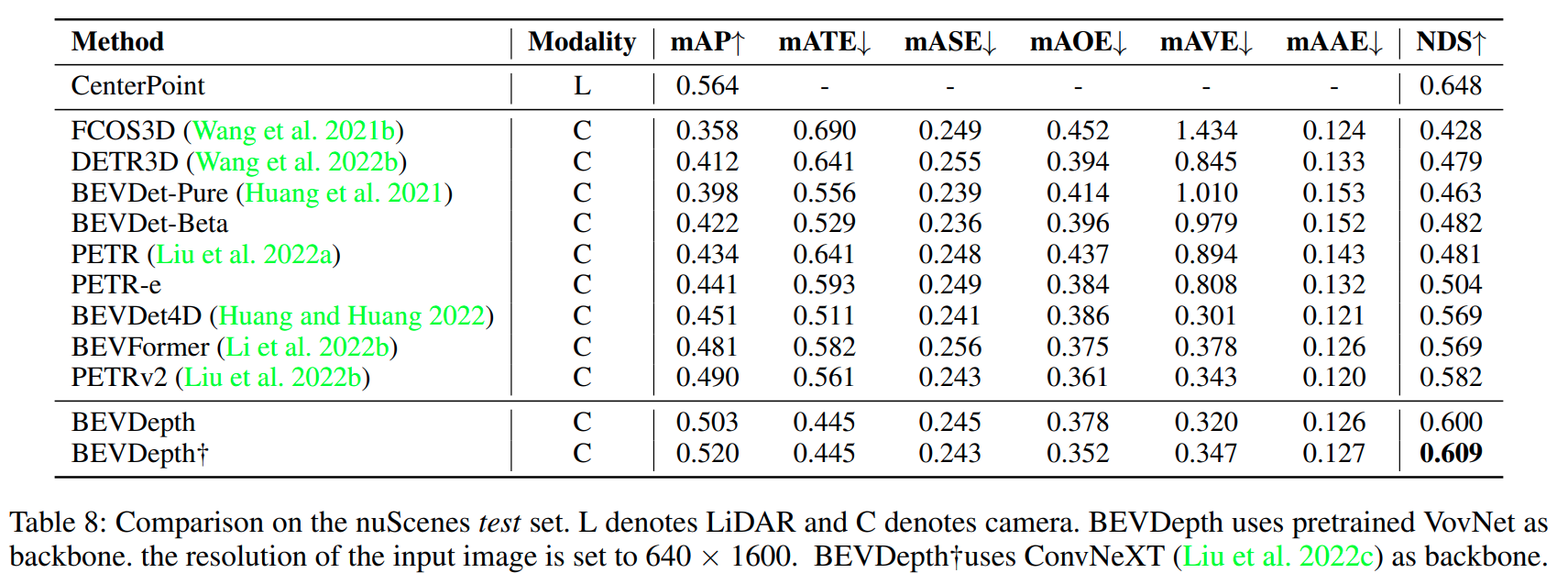

显式监督效果和 baseline 对比还是很赞的!

MAP和NDS吊打了一众基于纯视觉的算法

Thought

- 多帧训练中过渡帧使用了

nuScenes数据集的Sweep数据(没有人工标注的原始数据,只包含图像和 lidar 点云),无形中拓展了数据量。 - 本文创新点不多,基本是

BEVDet4D + DepthNet,更像是一个工程优化,比如:用cuda写了voxel pooling过程,计算过程非常高效。